Jetson Orin Nano resuelve los retos de la inteligencia artificial básica y multiplica por 80 el rendimiento de Jetson Nano.

NVIDIA acaba de presentar los nuevos módulos de sistema Jetson Orin Nano, que establecen un nuevo estándar para la robótica y la inteligencia artificial básica.

Por primera vez, la familia Jetson de NVIDIA abarca seis módulos de producción basados en Orin para dar soporte a una amplia gama de aplicaciones de inteligencia artificial y robótica.

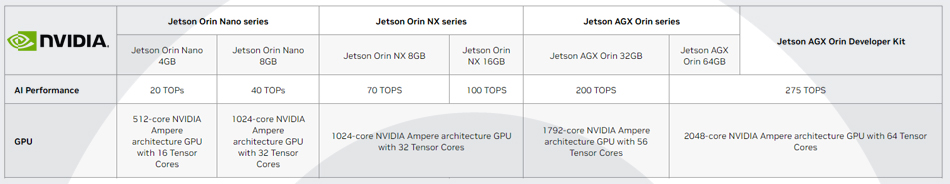

Esto incluye desde el Orin Nano, que proporciona hasta 40 billones de operaciones por segundo (TOPS) de rendimiento de IA en el formato Jetson más pequeño, hasta el AGX Orin, con 275 TOPS para máquinas autónomas avanzadas.

El Jetson Orin incorpora una GPU de arquitectura NVIDIA Ampere, CPU basadas en Arm, aceleradores de visión y aprendizaje profundo de última generación, interfaces de alta velocidad, rápido ancho de banda de memoria y soporte de sensores multimodales.

Este rendimiento y versatilidad permite a más clientes comercializar productos que antes parecían imposibles, desde ingenieros que despliegan aplicaciones edge AI hasta desarrolladores de Robotics Operating System (ROS) que construyen máquinas inteligentes de última generación.

"Más de 1.000 clientes y 150 partners han adoptado Jetson AGX Orin desde que NVIDIA anunció su disponibilidad hace sólo seis meses, y Orin Nano ampliará significativamente esta adopción", afirma Deepu Talla, vicepresidente de sistemas embebidos y edge computing en NVIDIA. "Con un aumento de órdenes de magnitud en el rendimiento para millones de desarrolladores de edge AI y ROS en la actualidad, Jetson Orin es la plataforma ideal para prácticamente cualquier tipo de implementación de robótica imaginable."

Mayor accesibilidad a la inteligencia artificial y la robótica de vanguardia

Los módulos Orin Nano son compatibles en factor de forma y pines con los módulos Orin NX anunciados anteriormente. La compatibilidad total con emulación permite a los clientes empezar a desarrollar para la serie Orin Nano hoy mismo utilizando el kit de desarrollo AGX Orin. Esto proporciona a los clientes la flexibilidad necesaria para diseñar un sistema que admita varios módulos Jetson y escalar fácilmente sus aplicaciones.

Orin Nano admite múltiples canalizaciones simultáneas de aplicaciones de IA con E/S de alta velocidad y una GPU NVIDIA de arquitectura Ampere. Los desarrolladores de dispositivos y aplicaciones de gama básica, como los análisis de comercio minorista y el control de calidad industrial, se benefician de un acceso más sencillo a modelos de IA más complejos a un coste menor.

Los módulos Orin Nano estarán disponibles en dos versiones: el Orin Nano de 8 GB puede proporcionar hasta 40 TOPS con una potencia configurable de 7 a 15 W, mientras que la versión de 4 GB ofrece hasta 20 TOPS con opciones de potencia de entre 5 y 10 W.

La plataforma Jetson Orin está diseñada para resolver los retos robóticos más difíciles y ofrece computación acelerada a más de 700.000 desarrolladores de ROS. Combinadas con las potentes funciones de hardware de Orin Nano, las mejoras introducidas en el último software NVIDIA Isaac para ROS ponen un mayor rendimiento y productividad en manos de los especialistas en robótica.

Sólido ecosistema y soporte de software

Jetson Orin ha recibido un amplio respaldo en todo el ecosistema de la robótica y la informática integrada, lo que incluye Canon, John Deere, Microsoft Azure, Teradyne, TK Elevator y muchos más.

El ecosistema NVIDIA Jetson está creciendo rápidamente, con más de 1 millón de desarrolladores, 6.000 clientes -incluidas 2.000 nuevas empresas- y 150 partners. Los partners de Jetson ofrecen una amplia gama de servicios que abarcan desde software de IA, hardware y servicios de diseño de aplicaciones hasta cámaras, sensores y periféricos, herramientas para desarrolladores y sistemas de desarrollo.

Módulos de producción basados en la familia Jetson Orin de NVIDIA

Módulos Jetson Orin Nano de 8 GB y 4 GB

Los módulos de la serie NVIDIA Jetson Orin Nano ofrecen hasta 40 TOPS de rendimiento de IA en el formato Jetson más pequeño, con opciones de alimentación de entre 5W y 15W. Esto le da hasta 80 veces el rendimiento de NVIDIA Jetson Nano y establece el nuevo estándar para la IA de borde de nivel de entrada.

Ambos módulos Jetson Orin Nano estarán disponibles en enero de 2023

Jetson AGX Orin módulos de 64 GB y 32 GB

NVIDIA Jetson AGX Orin ofrecen hasta 275 TOPS de rendimiento de IA con una potencia configurable entre 15W y 60W. Esto le proporciona hasta 8 veces el rendimiento de Jetson AGX Xavier en el mismo factor de forma compacto para robótica y otros casos de uso de máquinas autónomas.

El módulo Jetson AGX Orin de 32 GB ya está disponible.

Jetson AGX Orin el de 64 GB estará disponible en diciembre de 2022.

Módulos Jetson Orin NX de 16 GB y 8 GB

Los módulos Jetson Orin NX ofrecen hasta 100 TOPS de rendimiento de IA en el factor de forma Jetson más pequeño, con una potencia configurable entre 10 W y 25 W. Esto le proporciona hasta 3 veces el rendimiento de Jetson AGX Xavier y hasta 5 veces el rendimiento de Jetson Xavier NX.

Jetson Orin NX 16 GB estará disponible en diciembre de 2022.

Jetson Orin NX de 8 GB estará disponible en enero de 2023.

Un vistazo en profundidad a los módulos Jetson Orin Nano de 8 GB y 4 GB

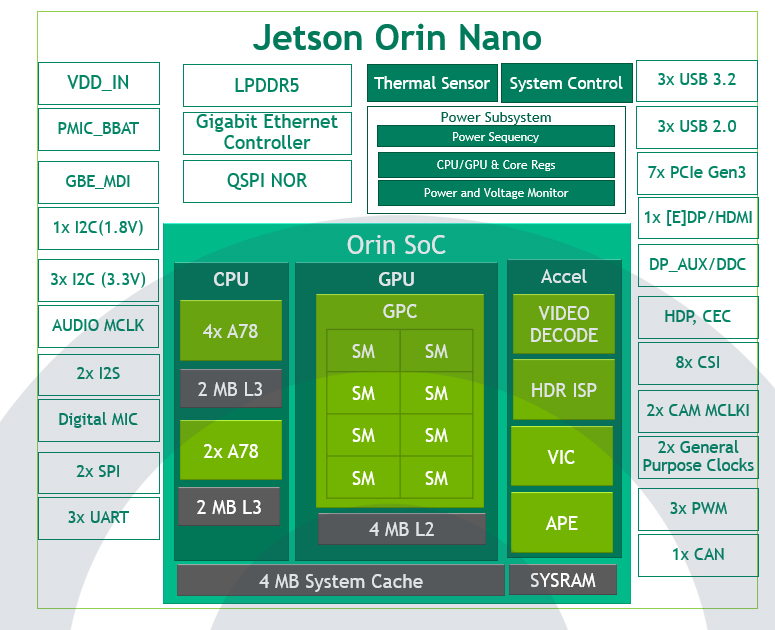

*La arquitectura NVIDIA Orin de Jetson Orin Nano 8GB, Jetson Orin Nano 4GB tiene 2 TPCs y 4 SMs.

Como se muestra en la Figura 1, Jetson Orin Nano presenta la arquitectura NVIDIA Orin con una GPU de arquitectura NVIDIA Ampere. Dispone de hasta ocho multiprocesadores de streaming (SM) compuestos por 1024 núcleos CUDA y hasta 32 Tensor Cores para procesamiento de IA.

Los Tensor Cores de tercera generación de la Arquitectura Ampere de NVIDIA ofrecen mejor rendimiento por vatio que la generación anterior y aportan más rendimiento con soporte para sparsity. Con sparsity, puedes aprovechar la dispersión estructurada de grano fino en redes de aprendizaje profundo para duplicar el rendimiento de las operaciones de Tensor Core.

Para acelerar todas las partes de tu canal de aplicaciones, Jetson Orin Nano también incluye una CPU Arm Cortex-A78AE de 6 núcleos, un motor de descodificación de vídeo, un ISP, un compositor de imágenes de vídeo, un motor de procesamiento de audio y un bloque de entrada de vídeo.

Dentro de su pequeño tamaño, 70x45mm 260-pin SODIMM, los módulos Jetson Orin Nano incluyen varias interfaces de alta velocidad:

- Hasta siete carriles de PCIe Gen3

- Tres puertos USB 3.2 Gen2 de alta velocidad a 10 Gbps

- Ocho carriles de puertos de cámara MIPI CSI-2

- Varios sensores de E/S

Para reducir el esfuerzo de ingeniería, hemos hecho que los módulos Jetson Orin Nano y Jetson Orin NX sean totalmente compatibles en cuanto a pines y factor de forma. La tabla 1 muestra las diferencias entre el Jetson Orin Nano de 4 GB y el Jetson Orin Nano de 8 GB.

| Especificaciones | Jetson Orin Nano 4GB | Jetson Orin Nano 8GB |

| Rendimiento de IA | 20 TOPs dispersos | 10 TOPs densos | 40 TOP dispersos | 20 TOP densos |

| GPU | gPU NVIDIA Ampere Architecture de 512 núcleos con 16 núcleos sensores | gPU con arquitectura NVIDIA Ampere de 1024 núcleos y 32 núcleos sensores |

| Frecuencia máxima de la GPU | 625 MHz | |

| CPU | cPU Arm Cortex-A78AE v8.2 de 6 núcleos y 64 bits 1,5 MB L2 + 4 MB L3 | |

| Frecuencia máxima de la CPU | 1.5 GHz | |

| Memoria | 4 GB LPDDR5 de 64 bits 34 GB/s | 8 GB 128 bits LPDDR5 68 GB/s |

| Almacenamiento | - | |

| (Admite NVMe externo) | ||

| Codificación de vídeo | 1080p30 soportado por 1-2 núcleos CPU | |

| Descodificación de vídeo | 1x 4K60 (H.265) | 2x 4K30 (H.265) | 5x 1080p60 (H.265) | 11x 1080p30 (H.265) | |

| Cámara | Hasta 4 cámaras (8 a través de canales virtuales*) 8 lanes MIPI CSI-2 D-PHY 2.1 (hasta 20 Gbps) | |

| PCIe | 1 x4 + 3 x1 (PCIe Gen3, puerto raíz y punto final) | |

| USB | 3x USB 3.2 Gen2 (10 Gbps) 3x USB 2.0 | |

| Redes | 1x GbE | |

| Pantalla | 1x DisplayPort 1.2 (+MST)/e DisplayPort 1.4/HDMI 1.4* multimodo 4K30 | |

| Otras E/S | 3x UART, 2x SPI, 2x I2S, 4x I2C, 1x CAN, DMIC y DSPK, PWM, GPIOs | |

| Alimentación | 5W - 10W | 7W - 15W |

| Mecánica | 69.conector SO-DIMM de 6 mm x 45 mm y 260 patillas | |

| Precio | $199† | $299† |

* Para obtener más información sobre la compatibilidad adicional con DisplayPort 1.4a y HDMI 2.1 y los canales virtuales, consulta la hoja de datos de la serie Jetson Orin Nano. † Volumen 1KU

Para obtener más información sobre las funciones compatibles, consulte la sección Funciones de software de la última Guía del desarrollador de NVIDIA Jetson Linux.

Pruebas de rendimiento con Jetson Orin Nano

Con Jetson AGX Orin, NVIDIA lidera la categoría de rendimiento de inferencia de MLPerf. Los módulos Jetson Orin suponen un paso de gigante para tus aplicaciones de última generación, y ahora la misma arquitectura NVIDIA Orin se hace accesible para los dispositivos de IA de gama básica.

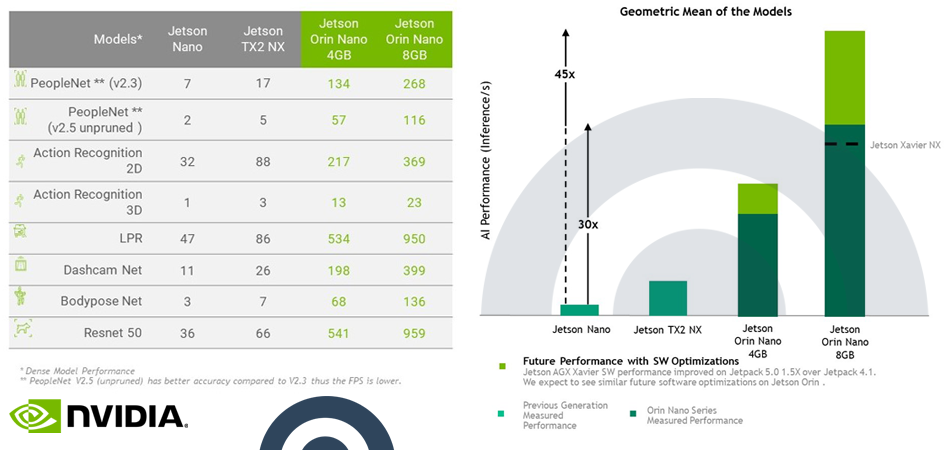

NVIDIA ha utilizado el modo de emulación con NVIDIA JetPack 5.0.2 para ejecutar pruebas de visión computerizada con Jetson Orin Nano, y los resultados muestran cómo establece el nuevo estándar. Las pruebas incluyeron algunos de nuestros densos modelos INT8 y FP16 preentrenados de NGC y un modelo ResNet-50 estándar. También ejecutaron los mismos modelos en Jetson Nano, TX2 NX y Xavier NX.

Aquí está la lista completa de pruebas:

- NVIDIA PeopleNet v2.3 para la detección de personas y NVIDIA PeopleNet v2.5 para la detección de personas con la máxima precisión

- NVIDIA ActionRecognitionNet para modelos 2D y 3D

- NVIDIA LPRNet para reconocimiento de matrículas

- NVIDIA DashCamNet, BodyPoseNet para la estimación de la pose humana de varias personas

- Modelo ResNet-50 (224×224)

Tomando el geomean de estos benchmarks, Jetson Orin Nano 8GB muestra un incremento de rendimiento 30 veces superior a Jetson Nano. Con futuras mejoras de software, NVIDIA espera que el rendimiento se aproxime a 45 veces. Otros dispositivos Jetson han multiplicado por 1,5 el rendimiento desde su primera versión de software compatible, y NVIDIA espera lo mismo con Jetson Orin Nano.